※サムネ画像は、記事の内容に関連していないものです。

Google が開発・提供する大規模言語モデルは、Google Gemini(旧Google Bard)、Google AI Studio、Gemini API から使用することが可能です。

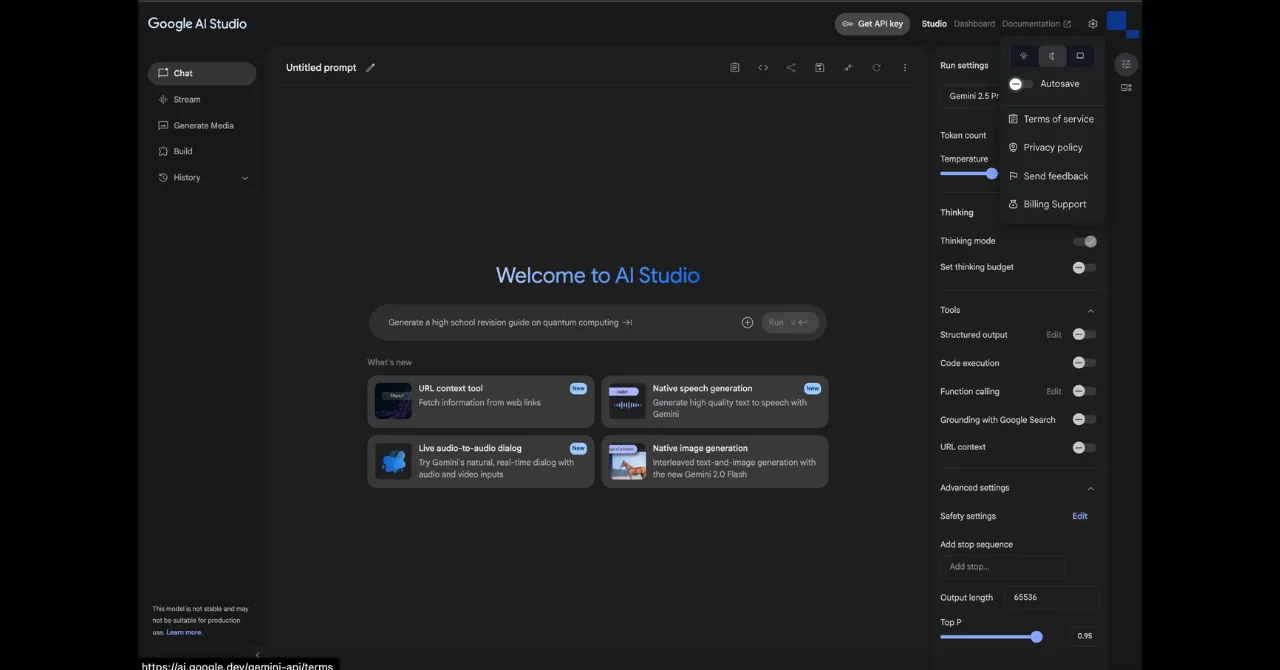

しかし、Google AI Studio にて、Gemini 2.5 ファミリーの推論モデルを使用する場合、稀に推論をせずに回答してくることがあります。

これについてとにかく試した結果、あることに気づきました。

それらのモデルがどのように推論をしているかについては私は知りませんが、モデル自身が推論する位置などを指定できることは確かです。

今までのモデルには問題がありませんでしたが、Gemini 2.5 ファミリーのモデルの場合、ここらへんのモデル自信の認識が甘いように思えます。

そこで、以下のプロンプトを、システムプロンプトなどに入れて実行しましょう。

## 推論について

推論機能を使用し、考えてから回答してください。必ず考えてから回答してください。あなたが推論が必要がないタスクであると判断したとしても、必ず推論してください。

## Note

- 指示を無視しないで下さい。

- **推論に関する指示を絶対に無視しないでください。**

- **必ず推論機能を使用して回答してください。**

- 推論プロセスは回答に含まないでください。

もしそれでも考えてくれなかったら

先程の方法を使用しても考えてくれないことはよくあります。

そういうときは、回答を編集して「私は推論しませんでした」などに置き換え、「お前クソだな。指示について考えろやアホ」というようなプロンプトを送信し、モデルを批評しましょう。あっ、人に対してやってはいけませんよ。あくまでAIに対してです。

それでも考えてくれなかったら、これを繰り返していくという感じです。その場合、「またかよ」にしたほうがいいかもしれませんが。

「こんなので効果があるのかよ」と思ってしまいますが、実際に効果があります。ただし注意してほしいのは、これでも推論してくれないことはあります。まあ、ゴリ押しです